Quand OpenAI annonce ses modèles o3 le dernier jour de l’évènement « 12 days of Shipmas », ils ont fait fort. Puisqu’actuellement tout le monde en parle.

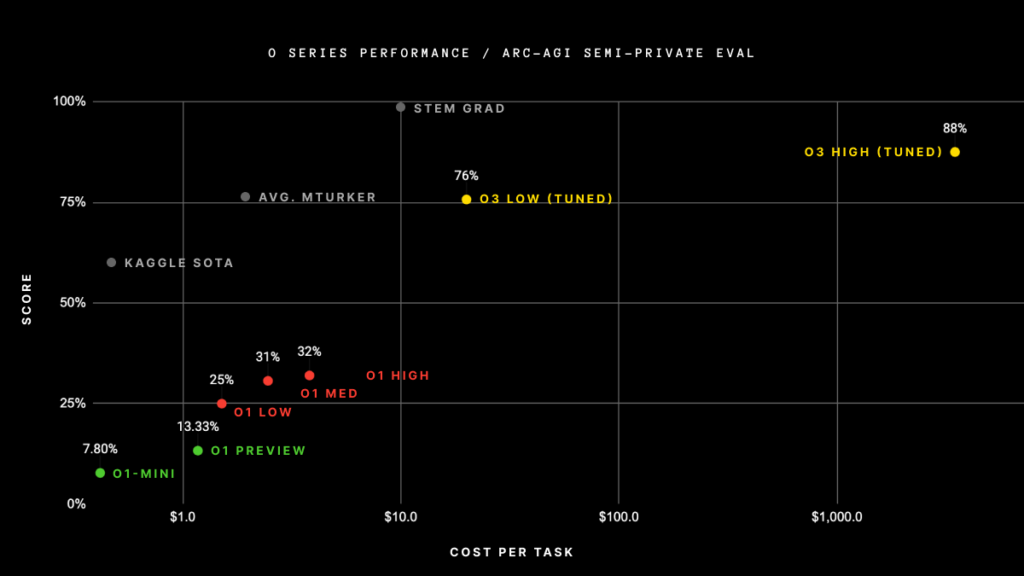

Avec des performances impressionnantes, notamment un score de 88 % au test ARC-AGI (contre seulement 32 % pour son prédécesseur, o1), ce modèle semble annoncer un nouveau chapitre pour l’intelligence artificielle.

Mais derrière ses prouesses techniques, il y a un petit détail qui pourrait gêner : son coût.

Performances extraordinaires… Coût astronomique

D’après François Chollet, le créateur du test ARC-AGI, o3 demande une puissance de calcul colossale, à tel point que chaque tâche peut coûter des milliers de dollars.

- Le calcul du modèle o3 pour le test ARC-AGI a coûté 170x plus que les précédents modèles.

- Comparé à l’o1, qui coûtait 5 $ de calcul par tâche, o3 monte à plus de 1 000 $.

- o3 nécessite 17 à 20 $ par tâche en mode de calcul faible.

👉 Pourquoi un tel coût ?

Avec le modèle o3, la qualité de la réponse est corrélée au coût de calcul. Plus de puissance de calcul est utilisée pendant l’inférence pour obtenir de meilleures réponses, ce qui se traduit par un coût plus élevé.

Parce qu’o3 repose sur un principe de « mise à l’échelle au moment du test« .

Plutôt que de consommer des ressources pendant la phase d’entraînement (comme le font les autres modèles), o3 doit mobiliser énormément de puissance chaque fois qu’on lui pose une question.

Résultat : il lui faut alors parfois jusqu’à 15 minutes de calcul intensif pour donner une réponse. En clair, poser une question à o3, c’est presque comme allumer une mini-centrale électrique.

Une IA réservée aux élites ?

👉 Non, on ne sait pas encore combien o3 va coûter.

En raison de son coût de fonctionnement élevé, il est donc peu probable que o3 devienne un « daily driver » pour l’utilisateur moyen.

Si tu pensais lui demander qui va gagner le prochain Ballon d’Or ou comment cuisiner des lasagnes maison, oublie.

Ce modèle est conçu pour des tâches ultra-complexes qui nécessitent un raisonnement approfondi : des calculs mathématiques de haut vol, des décisions stratégiques cruciales, et des projets de recherche de longue haleine.

👉 Il est donc peu probable qu’il arrive dans l’offre ChatGPT Pro à 200 $ par mois.

Certaines rumeurs parlent déjà de tarifs à 2000 $ par mois. Un prix réservé aux grandes entreprises, chercheurs et laboratoires avec un financement béton.

Et c’est peut être mieux ainsi.

En quoi c’est une bonne chose ?

Selon moi si OpenAI commercialise o3 à un prix stratosphérique, c’est plutôt une bonne chose.

Parce que ça limite son accès aux petites entreprises et aux startups qui peuvent toujours continuer à utiliser les modèles GPT-4o ou o1 pour développer des produits géniaux.

👉Seules les boîtes avec de gros moyens – et donc des projets sérieux – pourront s’y frotter.

On critique souvent les grosses boîtes, mais elles ont les moyens de s’attaquer à des problèmes qui comptent. On parle de recherche médicale, de lutte contre le changement climatique, ou de modélisation pour prévenir des catastrophes naturelles.

👉 Là, on parle de résoudre des vrais casse-têtes, des problèmes complexes, des trucs qui pourraient vraiment faire avancer l’humanité.

Et o3 est pile le genre de modèles dont on a besoin pour attaquer ces défis.

Bien sûr, il n’est pas parfait. Les hallucinations existent encore. Mais les performances, notamment sur des tests ultra-complexes, montrent un potentiel immense.

Ce qu’il faut retenir

Certains diront que c’est frustrant de voir l’IA devenir un outil réservé aux élites.

Mais soyons lucides : une telle puissance n’a pas besoin d’être entre toutes les mains.

👉 On a déjà assez d’automatisations inutiles dans nos vies.

Oui, je parle de cette IA qui te fait des playlists Spotify que tu zappes au bout de deux morceaux, qui te génères des idées de vidéos Youtube, automatises tes commentaires sur LinkedIn….

Avec o3, on change de dimension.

- Ce modèle n’est pas là pour « remplacer » les humains dans des tâches simples.

- Il est là pour accomplir des trucs qu’on ne peut pas faire seul, peu importe le temps ou les efforts.

- Et vu son coût, il sera utilisé là où ça compte vraiment, là où l’IA doit être utilisée avec sérieux et responsabilité.

Au lieu de craindre l’inaccessibilité d’o3, voyons ça comme une chance.