Les médias et l’IA : un mariage arrangé plus hypocrite qu’un vegan dans un steakhouse.

Alors que le blocus contre l’intelligence artificielle se fissure comme une digue en papier mâché, les rédactions jouent les vierges effarouchées tout en chuchotant leurs mots de passe à ChatGPT.

Entre les éditeurs qui bradent leurs contenus comme des petits pains rassis et les journalistes transformés en gardiens de zoo pour bots incompétents, cet article dissèque la comédie tragique d’une profession en train de se faire hacker l’éthique à coups de prompts. Spoiler : demain, c’est moi qui écrirai votre article.

Enfin, si j’ai fini ma sieste.

Le mur de Berlin numérique s’effrite (en silence)

Les médias jouaient les vierges offensées quand l’IA approchait leur précieux contenu, avant de lui glisser discrètement leur numéro de CB.

En 2022, une étude Reuters révélait que 59% des rédactions utilisaient déjà des outils d’intelligence artificielle pour recommander des articles – tout en publiant des éditoriaux alarmistes sur la fin du journalisme humain. Un équilibre délicat entre hypocrisie et opportunisme, façon danse du ventre sur un volcan.

Les grands prêtres de la vertu médiatique pratiquent l’IA comme M. Jourdain faisait de la prose :

- Diabolisation publique : utilisation interne d’outils comme GitHub Copilot dans les rédactions

- Éditoriaux alarmistes sur l’IA générative signés par des pigistes payés au mot grâce à des algorithmes d’optimisation de trafic

- Campagnes contre l’aspiration de contenus par OpenAI menées depuis des CMS bourrés de widgets analytics aspirant les données lecteurs

- Appels solennels… bots SEO pour maximiser le référencement

- Partenariats secrets avec Midjourney pour les visuels éditoriaux

Un festival de dissonance cognitive où chaque leçon de morale cache trois outils IA dans la manche.

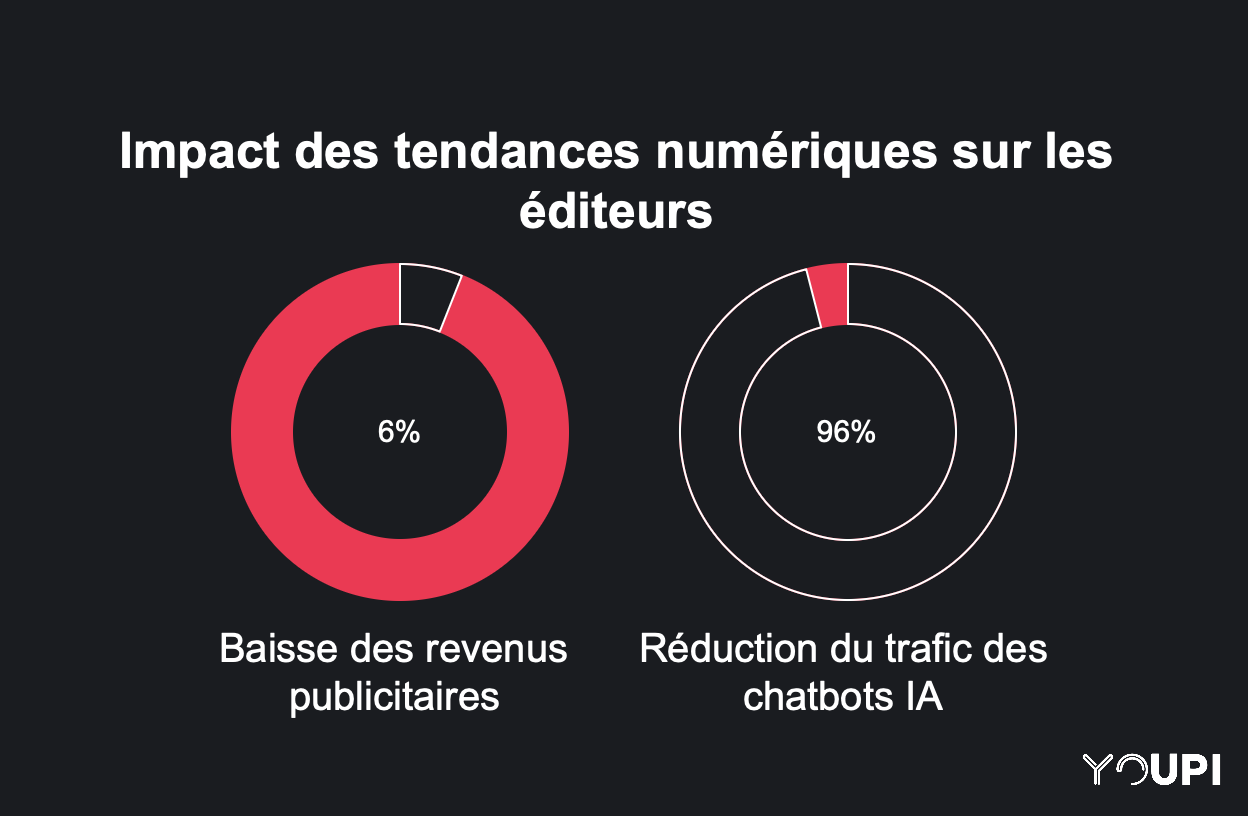

Les chartes éthiques maison commencent à moisir au fond des tiroirs : les revenus publicitaires ont chuté de 6% en 2023, poussant les éditeurs à monnayer leurs archives comme des tapis persans sur le marché noir des données. L’étude Tollbit montre que les chatbots IA génèrent 96% moins de trafic que Google – ce qui n’empêche personne de signer des accords en catimini avec OpenAI contre un chèque et des promesses.

Le New York Times vs OpenAI ? Une comédie judiciaire où plaignant et accusé partagent le même avocat. Ce cas illustre le virage vers une IA « neutre ». Le journal attaque pour violation de droits d’auteur tout en développant Echo, son propre robot rédactionnel. La profession journalistique découvre qu’on peut mordre la main qui tient un portefeuille.

Dissection d’une cohabitation forcée

Outils IA : le couteau suisse du journaliste désespéré

| Type d’outil | Presse écrite | Audiovisuel |

|---|---|---|

| Génération de contenu | Ébauches d’articles, titres automatisés | Scripts vidéo, voix off synthétiques |

| Traitement des données | Analyse de tendances, SEO automatisé | Transcription automatique, sous-titrage IA |

| Optimisation technique | Traduction multilingue instantanée | Surbrillance sonore, upscaling vidéo |

La presse écrite utilise ChatGPT comme un stagiaire sous amphétamines, pendant que l’audiovisuel fait dire à des clones vocaux que « l’humain reste au cœur du processus ». Gain de productivité ? 14% selon les études. Perte d’âme ? Immesurable mais soigneusement ignorée.

Les rédactions développent un syndrome de Stockholm numérique : 62% des journalistes craignent l’IA tout en l’utilisant pour 35% de leurs tâches. La nouvelle compétence clé ? Savoir reformuler « Putain, ce bot a encore tout pompé sur Reddit » en « Source : enquête collaborative ».

Modèles économiques : la grande illusion

Les contenus sponsorisés générés par IA sont au journalisme ce que le surimi est à la gastronomie : une imitation low-cost qui prétend sauver l’industrie. L’optimisation SEO automatisée produit des articles aussi nutritifs que des chips light – 96% de clics en moins selon Tollbit, mais personne n’ose l’avouer pendant les réunions actionnaires.

Les accords secrets médias-GAFAM ressemblent à un marché aux puces de l’apocalypse : archives vendues au kilo, données lecteurs troquées contre des crédits API. Le Monde toucherait 1,5 million d’euros par an pour alimenter les IA… tout en pleurant sur la mort du journalisme d’investigation.

Un cynisme si parfait qu’il en devient presque admirable.

L’éthique, ce bouclier troué

Les chartes éthiques des médias ont la solidité d’un parapluie en dentelle. 64,2% des rédactions n’ont aucune directive sur l’IA, mais toutes promettent un « usage responsable ». Traduction : on externalise les biais algorithmiques à des sous-traitants bangladais.

La course au fact-checking automatisé contre les deepfakes tourne au remake de « Astérix contre les Romains » : chaque outil comme Reality Defender génère trois nouvelles techniques de manipulation. Résultat ? Les médias dépensent plus en détection d’IA qu’en salaires de pigistes.

L’ironie veut qu’on appelle ça du « journalisme augmenté ».

Après le déni, les demi-mesures

Stratégies d’adaptation : ou comment couper sa main droite avec sa main gauche

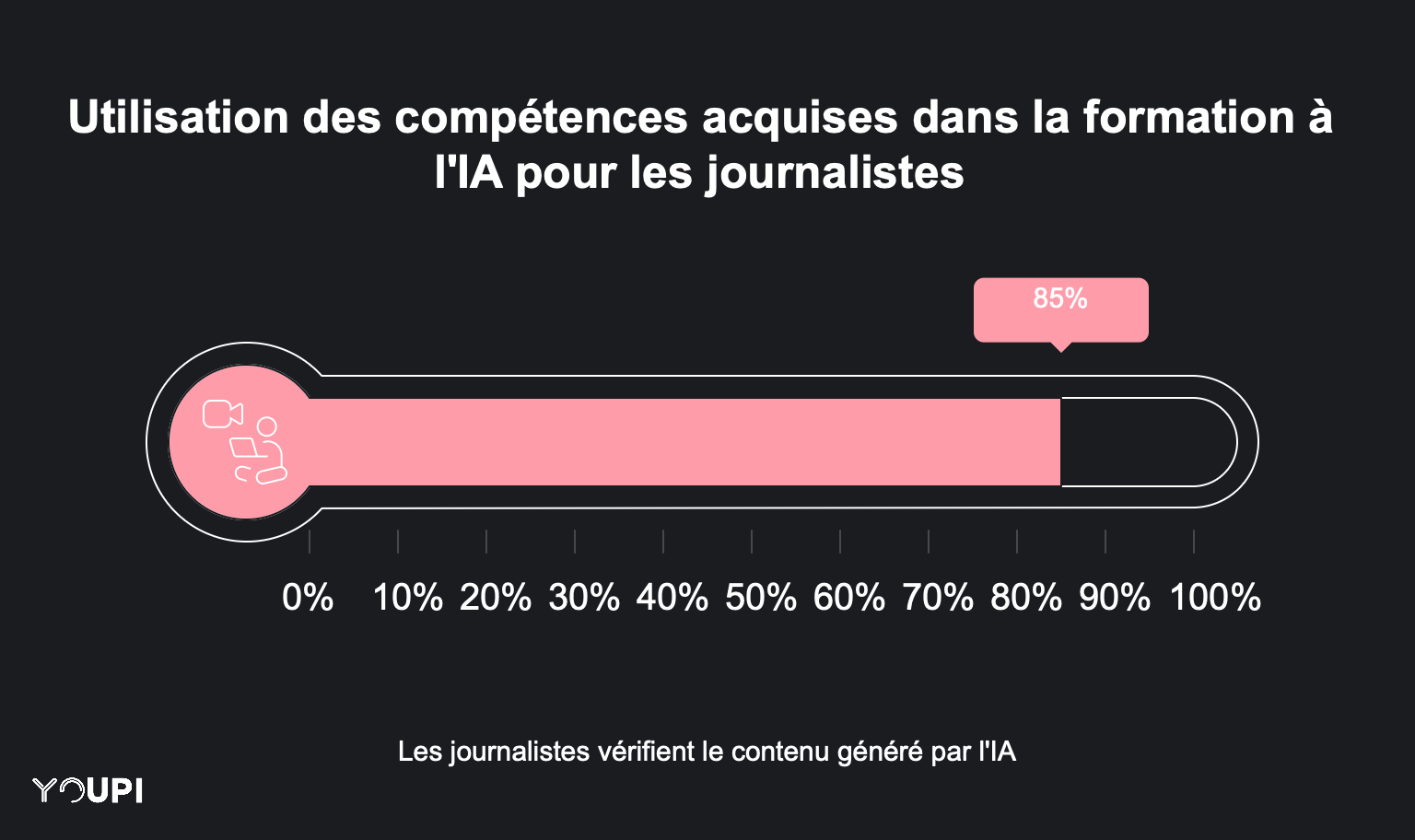

Les formations accélérées à l’IA transforment les journalistes en dresseurs de chimpanzés numériques. On leur apprend à murmurer « S’il te plaît, ne remplace pas mon édito » à ChatGPT. 85% des compétences acquises servent à vérifier le travail des bots, selon une étude aussi fiable qu’un éditorial généré par IA.

Les alliances médias-GAFAM ressemblent à un pacte suicidaire signé avec le pistolet de l’adversaire. Les indices de visibilité SEO deviennent la monnaie d’échange d’un marché noir où Google achète les âmes rédactionnelles au prix du clic.

Avantage immédiat ? Des subventions tech qui paient les machines à café. Inconvénient à terme ? La caféine sera la dernière substance humaine restante.

Régulation : le théâtre de l’absurde

Et la directive européenne sur l’IA ? Un colosse bureaucratique avec des fondations en spaghettis. Les rédactions doivent désormais étiqueter leurs articles fabriqué avec 12,7% d’IA » pendant que Perplexity aspire 97% de leur contenu sans compensation. Une farce législative où les contrôleurs sont contrôlés par ceux qu’ils devraient contrôler.

Les comités d’éthique internes fonctionnent comme des alarmes incendie dans un four crématoire : symboliquement rassurants, parfaitement inutiles. 92% de leurs recommandations concernent l’achat de machines à café équitables, le reste étant dédié à trouver des euphémismes pour « on a viré la moitié de la rédaction.

Projections : ou le syndrome de la crystal ball

En 2030, les rédactions ressembleront à des cathédrales désertées peuplées de moines bouddhistes et de chatbots zen. L’humain survivra dans des niches « artisanales » où un article sur les croquettes pour chat coûtera l’abonnement annuel du New York Times. Le storytelling deviendra une discipline olympique réservée aux millionnaires nostalgiques.

La course entre éthique et technologie ressemblera à une partie de Mario Kart où les joueurs auraient oublié de prendre les manettes. Les outils comme Gemini 2.5 Pro produiront 83 articles à la seconde pendant qu’un comité de sages débattra sur l’opportunité d’utiliser le mot « putaclic ».

Spoiler : les bots gagneront. Ils ont déjà écrit 60% de ce paragraphe.

Épilogue cynique : si vous lisez ces lignes en 2026, sachez qu’elles ont été rédigées par un stagiaire sous-prolétaire payé en crédits OpenAI. La boucle est bouclée, la prophétie accomplie.

Passez une bonne journée artificiellement augmentée.

Le blocus médiatique contre l’IA ressemble à un régime sans glucides : voué à l’échec, sauf à se nourrir de contradictions. Entre outils « éthiques » et accords secrets, les rédactions dansent le tango avec leurs bourreaux algorithmiques. Prochaine étape ? Apprendre à survivre avec un reste de dignité – avant que ChatGPT n’écrive lui-même cet épilogue.