Aujourd’hui, on va parler de Qwen2.5-Max, le modèle d’IA d’Alibaba qui veut se mesurer à GPT-4o et DeepSeek V3.

Honnêtement, je suis passée à côté au début. Comme beaucoup je crois.

On était plutôt à fond sur o3-mini, Deep Research et d’autres nouveautés comme Sonar de Perplexity.

Mais voilà, Qwen2.5-Max a grimpé les classements et commence à montrer qu’il ne faut pas le prendre à la légère.

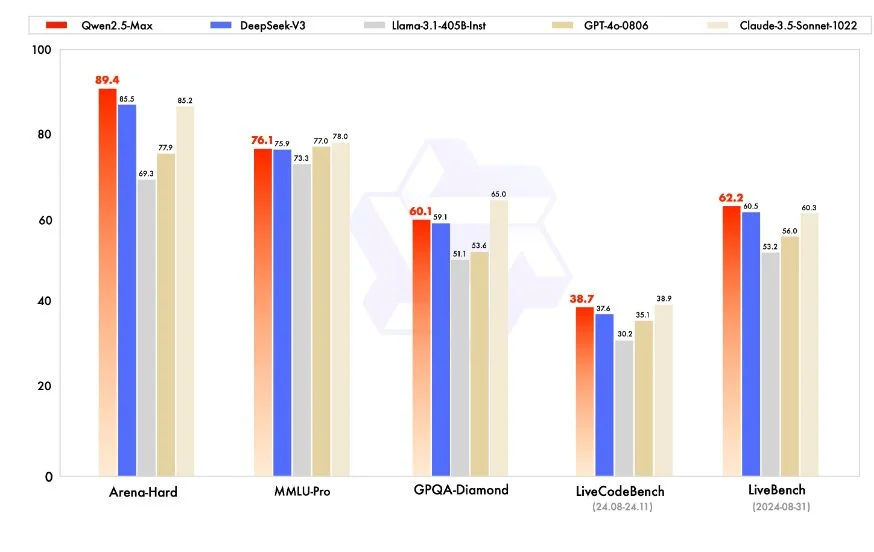

Performant en compréhension, en programmation et en raisonnement selon ce que suggèrent les benchmarks, il dépasse même certains modèles américains et chinois sur des benchmarks-clés.

Alors, est-ce que c’est le grand rival de DeepSeek et OpenAI ou juste un buzz passager ?

J’ai creusé la question (histoire de ne plus être à la traîne), et on va voir ensemble si Alibaba a vraiment de quoi inquiéter la concurrence… ou si c’est juste une belle vitrine pour son cloud.

Qwen2.5-Max : Alibaba grimpe dans les classements

Lancé discrètement pendant le Nouvel An lunaire, Qwen2.5-Max d’Alibaba Cloud a réussi un joli coup : il surpasse actuellement DeepSeek-V3 sur ChatbotArena.

📌 Classement actuel :

• 3ᵉ place → DeepSeek-R1 (toujours solide)

• 7ᵉ place → Qwen2.5-Max (nouveau challenger sérieux)

• 9ᵉ place → DeepSeek-V3 (en perte de vitesse)

Chatbot Arena, un benchmark géré par des chercheurs de l’UC Berkeley, évalue les performances des IA selon les votes des utilisateurs. Autrement dit, ce classement reflète l’expérience réelle des utilisateurs.

👉 Ça ne veut pas dire que DeepSeek est largué, mais que la compétition s’intensifie.

Pourquoi Qwen2.5-Max fait la différence ?

Un modèle qui ne fait pas les choses à moitié

Qwen2.5-Max est un modèle MoE (Mixture-of-Experts). En gros, il ne repose pas sur une seule IA, mais sur une équipe de sous-modèles spécialisés, qui bossent ensemble comme une escouade bien rodée.

Pourquoi c’est malin ? Parce que ça consomme moins de ressources et ça donne de meilleures réponses sur certaines tâches précises.

En gros, Alibaba a conçu une IA qui excelle dans plusieurs domaines clés, en fonction des besoins de l’utilisateur.

👉 Honnêtement, sur le papier, ça m’a l’air plutôt intéressant.

Qwen2.5-Max a été entraîné sur 20 000 milliards de tokens

Oui, tu as bien lu. C’est un volume d’entraînement monstrueux, digne des plus gros modèles du marché. De quoi donner des sueurs froides aux concurrents…

Pour rappel Llama 3.1 405B de Meta a été entraîné sur plus de 15 000 milliards de tokens et DeepSeek R1 sur 14 800 milliards de tokens.

Pour l’entraînement, Alibaba a misé sur une phase de raffinage avancée combinant :

📌 Apprentissage supervisé (SFT) : le modèle apprend à partir d’exemples détaillés

📌 Apprentissage par renforcement avec feedback humain (RLHF) : il est affiné grâce aux retours d’utilisateurs réels

Ce cocktail lui permet de rivaliser avec GPT-4o (OpenAI), Claude 3.5 Sonnet (Anthropic) et LLaMA 3.1-405B (Meta) sur plusieurs benchmarks de référence.

👉 Alibaba ne se contente plus de concurrencer DeepSeek : il vise aussi OpenAI et Meta.

Qwen2.5-Max en vrai : un modèle top… mais pas parfait

D’après les tests, il ressort que Qwen2.5-Max est :

- Précis, intelligent et plutôt rapide

- Très bon en codage et logique

- Moins bridé sur les sujets sensibles que certaines IA chinoises

Mais (parce qu’il y a toujours un « mais ») :

❌ Lent sur certaines requêtes (pas dramatique, mais GPT-4o est plus fluide)

❌ Génération d’images médiocre (si c’est pour rivaliser avec DALL-E ou Midjourney, c’est raté)

👉 En gros, le modèle semble super performant, mais pas encore parfait.

Alibaba propose deux versions distinctes de Qwen2.5-Max :

- Une version fondamentale, pour un usage général

- Une version « instruct », optimisée pour la conversation et la programmation

📌 Où peut-on l’utiliser ?

- Sur l’écosystème cloud d’Alibaba (identifiant : qwen-max-2025-01-25)

- Sur Qwen Chat (inscription requise)

- Via son API, compatible avec l’API OpenAI (pratique pour les entreprises)

Alibaba, un vrai concurrent pour OpenAI et DeepSeek ?

Avec Qwen2.5-Max, Alibaba s’impose dans le game face à un DeepSeek qui a fait sensation et qui inquiète.

Je retiens que c’est :

- Un modèle ultra-compétitif en texte et programmation

- Un vrai challenger face aux IA américaines et chinoises

- Encore nul sur la génération d’images

👉 Mon avis : la Chine ne veut plus être simple spectatrice face aux modèles américains.

Toutefois, je doute que Qwen2.5-Max s’impose aux mastodontes américains, surtout avec la méfiance grandissante envers les IA chinoises.

Son destin est-il déjà tracé ? Pourra-t-il être utilisé librement en Occident et aux États-Unis, ou va-t-il, comme DeepSeek, se retrouver dans le viseur des régulateurs ?

Franchement, vu le climat actuel, il est possible que ce modèle finisse par être limité ou banni sur fond de tensions géopolitiques et de craintes sur l’exploitation des données.

Tu penses que Qwen2.5-Max est un vrai rival pour OpenAI et DeepSeek ou juste un feu de paille ?

Tu as envie de le tester ?

Partage l’article sur LinkedIn ou ton réseau social préféré pour en discuter avec tes abonnés.